Ilustrační foto FOTO: AdobeStock

FOTO: AdobeStock

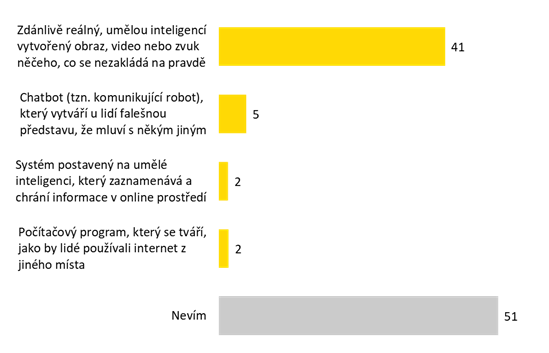

Téměř tři pětiny respondentů poslední vlny průzkumu CEDMO Trends nevěděly, co je to deepfake, tedy zdánlivě reálný, umělou inteligencí vytvořený obraz, zvuk nebo video, které se nezakládají na pravdě. Přes 60 procent lidí má zároveň obavu, že politici a politické strany začnou falešná videa využívat k očernění svých politických konkurentů.

U otázky zjišťující znalost deepfaků zvolilo jednu správnou odpověď ze čtyř nabízených pouze 41 procent respondentů, uvedli autoři průzkumu v tiskové zprávě. Více než polovina jich uvedla, že neví, a zbývající desetina označila špatnou odpověď. Současně 35 procent lidí uvedlo, že se s deepfake obsahem v posledních měsících setkala.

51 procent respondentů uvedlo, že neví, co je deepfake FOTO: CEDMO Trends / se souhlasem

FOTO: CEDMO Trends / se souhlasem

„V odpovědích respondentů se statisticky významně častěji objevovala správná varianta u mužů oproti ženám,“ komentuje zjištění průzkumu datový analytik CEDMO Lukáš Kutil.

„V kategoriích věku se to týkalo všech ročníků, od nejmladších až do 44 let. Ty průměrně odpovídaly správně v 59 procentech případů. Oproti tomu starší ročníky nad 45 let průměrně odpovídaly správně jen ve 29 procentech případů. Z hlediska vzdělání dokáží deepfake správně definovat vysokoškolsky vzdělaní lidé. Z hlediska regionu to jsou lidé z Prahy a středních Čech. Z ekonomického hlediska jsou to kromě studentů také OSVČ a z hlediska politických preferencí jsou to nejčastěji voliči koalic PirSTAN, ale také Trikolory + Svobodných + Soukromníků, což je zajímavé, protože se jedná o voliče dvou koalic, jejichž voličská základna se typicky nepřekrývá. Jako společný jmenovatel můžeme hledat zařazení sebe sama na liberální straně politického spektra, neboť správné odpovědi se významně častěji objevovaly právě u liberálních voličů. V závěsu se objevují také voliči koalice SPOLU,“ dodává.

Podle dat České asociace umělé inteligence za loňský rok světově vzrostl počet takzvaných deepfaků, tedy falešných videí, podvržených fotek nebo audionahrávek, na desetinásobek. Jen v Evropě byl zaznamenán nárůst těchto útoků o 780 procent. Tato technologie se bude dál vyvíjet a může ovlivňovat mínění lidí.

Deepfaků se během loňského roku na sociálních sítích objevilo nespočet. Velkou reakci ale vyvolaly zejména údajné fotky ze zatčení Donalda Trumpa nebo snímek zobrazující výbuch poblíž Pentagonu. V období parlamentních voleb na Slovensku bylo pomocí řetězových e-mailů šířeno deepfake audio, na němž lídr strany Progresivní Slovensko Michal Šimečka údajně diskutoval o plánech na manipulaci s volbami. Vznikala také různá videa a nahrávky s českým prezidentem Petrem Pavlem.

V lednu se šířilo umělé video s ministrem vnitra Vítem Rakušanem (STAN), na kterém má říkat, že „vydrbe s dezoláty“ v Karviné a pak je „zcenzuruje“. Toto video podle průzkumu zaznamenala přibližně třetina populace, za autentické je považovalo 17 procent dotázaných. Jednalo se přitom o jednu z dezinformací, které ve sledovaném období zaujaly respondenty nejvíce.

Obavu, že politici a politické strany začnou falešná videa využívat k očernění svých politických konkurentů ve velkém, vyjádřilo 63 procent respondentů. Více než tři čtvrtiny z nich se také domnívají, že lidé přestanou věřit reálným videím, a přibližně stejné procento souhlasí s tvrzením, že provozovatelé sociálních sítí a internetu by měli umělou inteligencí generovaná nepravdivá videa mazat.

„Podíl dezinformací vytvořených prostřednictvím umělé inteligence v celkovém počtu nepravdivých zpráv kolujících ve veřejném prostoru je zatím relativně nízký,“ uvedl Petr Gongala, koordinátor factcheckingové platformy Demagog.cz, která denně ověřuje výroky politiků v médiích i pravdivost hojně sdíleného obsahu na sociálních sítích v Česku. Současně také spolupracuje s desítkami partnerských factcheckingových organizací celoevropské sítě EDMO, jíž je CEDMO součástí.

„Ve stejném období, kdy na sociálních sítích kolovalo falešné video s ministrem vnitra Rakušanem, byla deepfake technika využita pouze u čtyř procent nepravdivých zpráv z bezmála patnácti set, které jsme spolu s dalšími 34 partnerskými factcheckingovými organizacemi sítě EDMO v průběhu ledna ověřovali,“ dodal Gongala.

To, jak dobře nebo špatně lze deepfake rozpoznat, záleží na jeho druhu a kvalitě. „Záleží, co všechno si pod pojmem deepfake představíme. Zatím jde (s určitým tréninkem) poznat vše. U klasických deepfaků poznáme ‚vyměněné‘ obličeje ve videu nejlépe, když se hlava různě pootáčí a obličej není nasměrovaný přímo k nám, ale najednou třeba z boku – často v takový moment postřehneme výraznější změnu struktury celého obličeje. V případech, kdy jde pouze o deepfake pusy (aby seděla s vygenerovanou řečí), lze postřehnout nesrovnalosti mezi pohyby a mimikou obličeje a pusy, případně může být pusa oproti zbytku podivně rozmazaná, pohybovat se jinak, než jsme u daného mluvčího zvyklí, a tak dále,“ popsal dříve deníku FORUM 24 Jakub Sedláček ze Studií nových médií FF UK a Národního institutu SYRI. Upozornil ale, že technologie se dál vyvíjejí a deepfake brzy už možná rozpoznat nepůjde.